안녕하세요! 이 글에서 아예 각 잡고 부품 구성부터 제가 왜 시놀로지를 떠나 이 세팅(MergerFS + SnapRAID)으로 정착했는지 아주 상세히 정리해 보았습니다.

1. 시스템 구성 요약 및 비용

[사진 첨부: 조립 완료된 프랙탈 7 XL 케이스 내부 또는 시스템 전체 모습]

CPU+보드: N100 NAS 전용 온보드 (195,500원)

케이스: 프랙탈 디자인 7 XL (중고, 235,000원) / HDD 트레이 3개 추가 (59,700원)

파워: 슈퍼플라워 1000W LEADEX 4 (170,000원)

RAM: 트랜센드 SO-DIMM DDR5-4800MHz 32GB (109,500원)

HBA 카드: 9300-16i (44,552원)

케이블류: SFF-8643 to SATA 및 전원 케이블 (46,026원)

NVMe SSD: 2개 구성 (OS 및 Velocity Pool 용도)

쿨링팬: 아틱팬(P14) + 터프팬14 조합 총 7개 (약 120,000원)

HDD: 14TB 중고 9개 (개당 약 15만 원, 총 1,350,000원) ※기존 보유 하드 제외 신규 추가분

보시면 아시겠지만 경제적인 문제로 중고를 구할 수 있는건 파워든 HDD든 가리지 않고 중고로 채워넣었습니다.

작년 9월, 불과 4개월 전이지만 HDD든 램이든 NVME든 많이 올라서 지금은 현실성이 없는 가격이네요..ㅜㅜ

사진 설명

N100보드는 미니ITX입니다. 케이스에 비해서 매우 작은 공간을 차지하고 있습니다.

꽂혀있는 카드는 SATA 확장 카드이며, 흘러나온 하늘색 케이블은 추후 확장을 위해 12개의 남는 SATA케이블 입니다.

2개의 NVME를 방열판을 달아서 설치한 상태입니다.

쿨링팬은 모두 7개로 상부 2개, 전면 3개, 후면 1개, 하부 1개 입니다.

사진설명

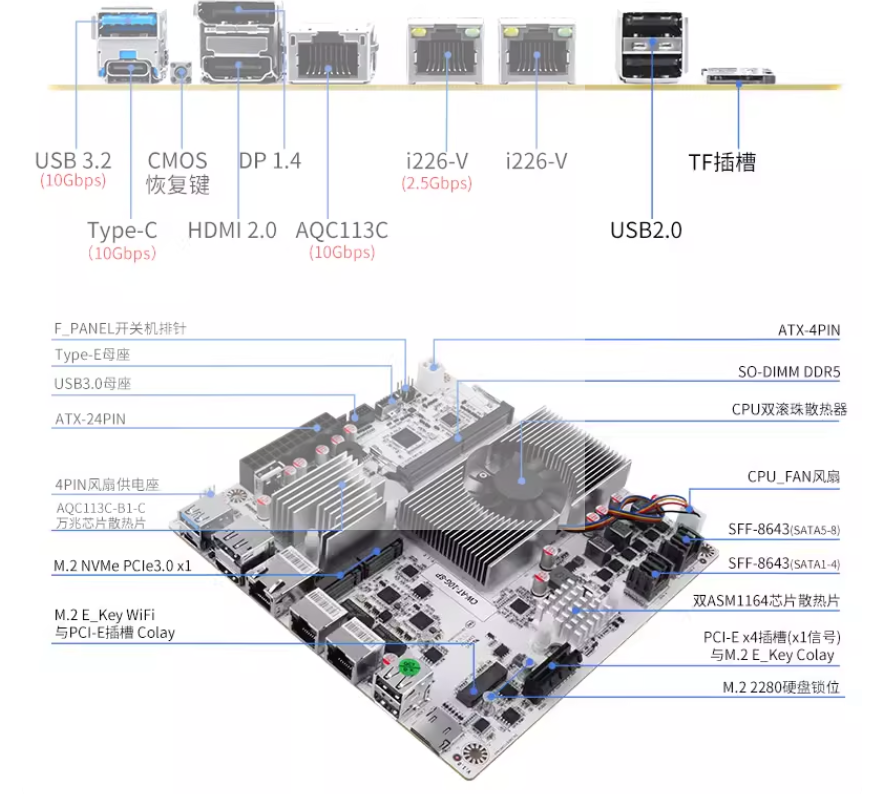

온보드 CPU이며, 아예 NAS제품이라고 홍보하며 판매합니다. 보시다시피 PCI 슬롯이 1개인것과 썬더볼트 미지원을 빼고는 기본은 하는 제품입니다. 참고로 알리익스프레스보다 타오바오에서 직구하는게 더 저렴합니다.

사진설명

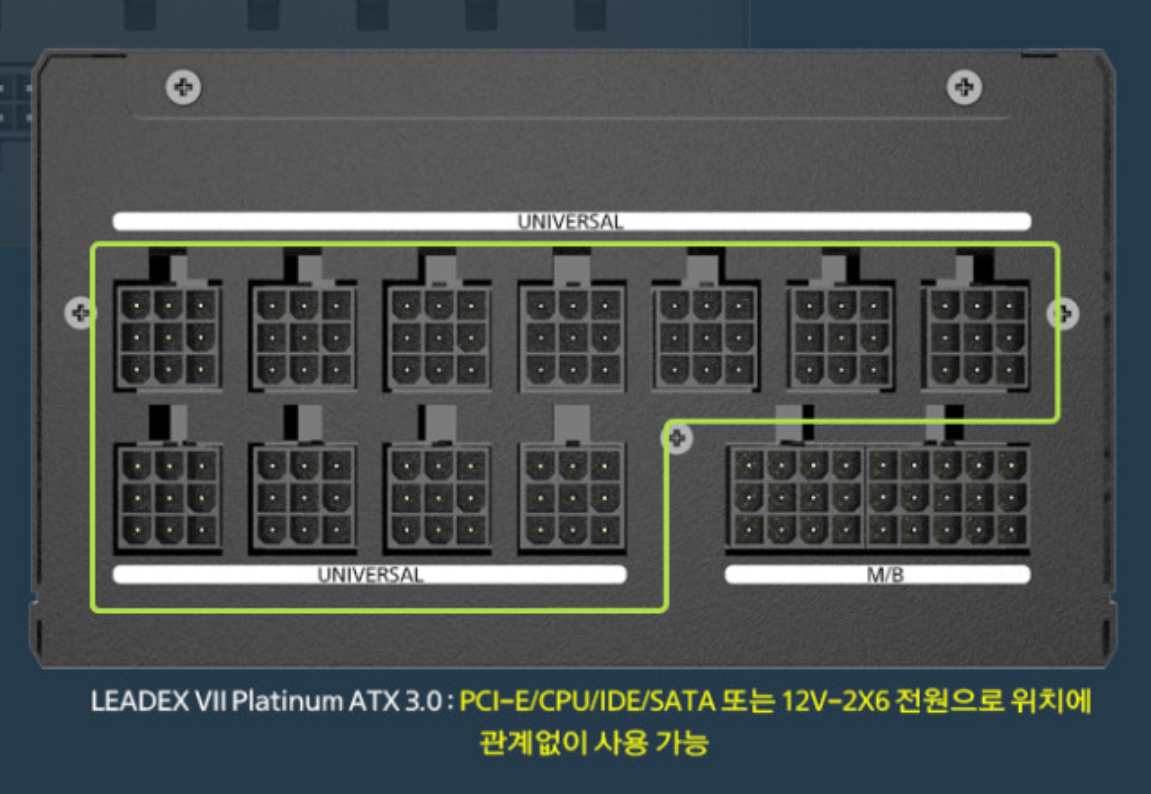

파워는 슈퍼플라워의 유니버셜 커넥터 지원

14개의 대용량 HDD가 부팅 시 동시에 스핀업(Spin-up) 할 때 발생하는 순간 전력(피크치)을 감안해 파워는 1000W로 넉넉하게 구성했습니다. 특히 슈퍼플라워 파워의 유니버설 커넥터 덕분에 SATA 파워 커넥터를 무려 11개나 직결할 수 있습니다. 최대 33개의 SATA파워 포트 (파워 케이블 1개에 4개 이상의 HDD 전원을 문어발로 연결하는 것은 비추천합니다.)

사진설명

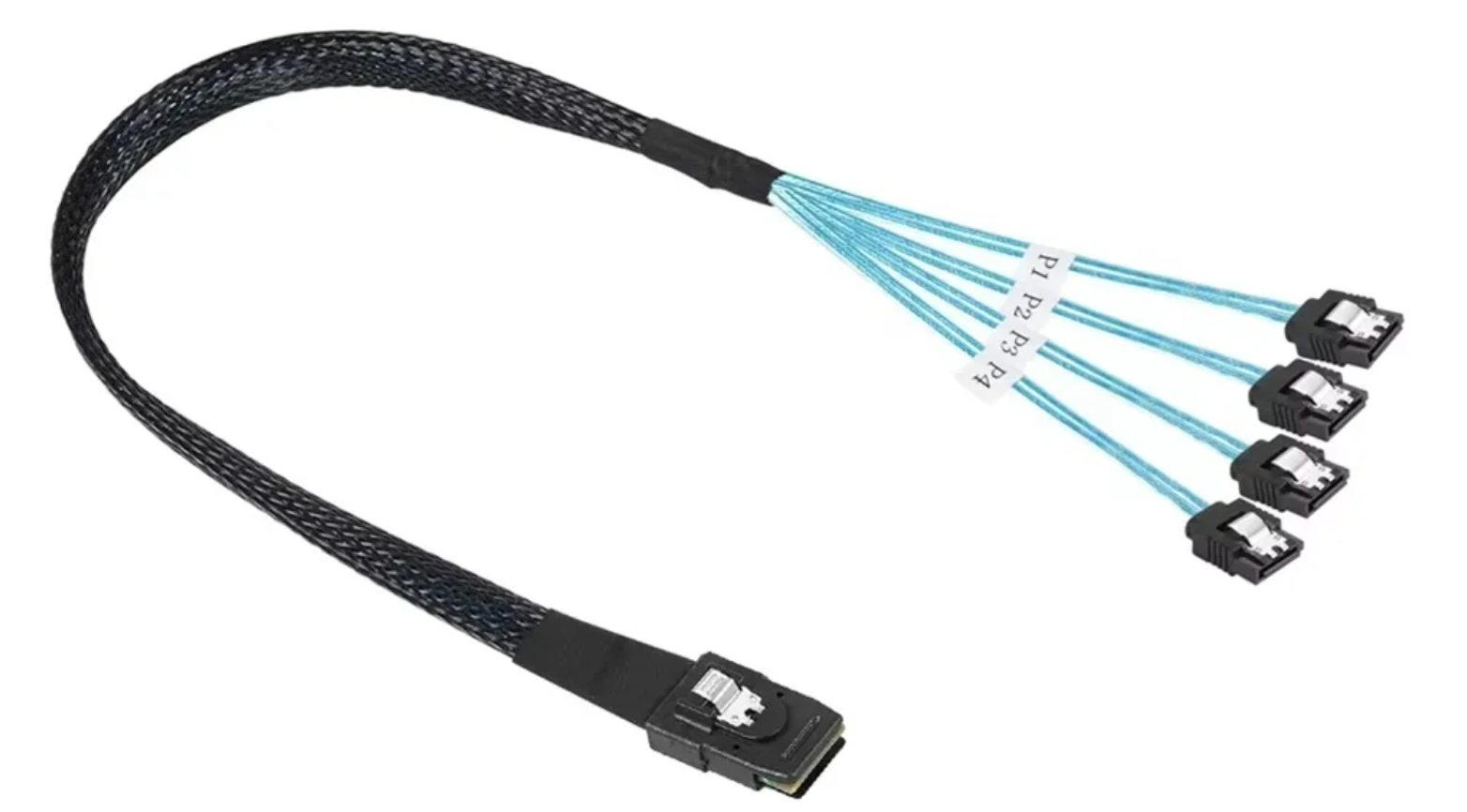

제가 사용중인 9300-16i SATA 확장카드. 4개의 커넥터 와 커넥터당 4개의 SATA포트를 통해 총 16개의 SATA포트 확보

사진설명

커넥터당 4개의 SATA포트가 달린 SFF-8643 케이블 (본체 메인보드에 달린 2개의 커넥터도 이 케이블을 사용합니다)

사진설명

저는 사용하지 않았으나, 원하면 NVME에 꽂을 수 있는 9개 SATA포트가 달린 확장카드

2. 왜 기성품을 버리고 자작으로 넘어왔는가? (압도적 차이)

[1] 본체값만 600만 원? 기업용 NAS를 씹어먹는 N100 가성비

이 보드는 중국에서 아예 'NAS용'으로 대놓고 나와 N100 CPU가 온보드로 장착되어 있습니다. 4K 하드웨어 트랜스코딩까지 완벽하죠. 라즈베리파이보다 전력을 3~4배 더 먹어봤자 10W 차이, 연간 전기세 1~2만 원 차이입니다. 시놀로지 기성품 중에서 N100보다 나은 CPU(인텔 제온 등)를 가진 모델을 찾으려면 DS1621xs+, DS3622xs+ 같은 무시무시한 기업용 라인을 봐야 하는데, 나스 깡통 본체 가격만 600만 원 이상입니다. 20만 원짜리 보드로 600만 원짜리 시놀로지 성능을 냅니다.

[2] 답답한 네트워크와 SATA 포트의 한계 돌파

시놀로지는 여전히 1GbE 포트를 고집하거나 10GbE 확장을 위해 또 비싼 전용 카드를 사야 하죠. 이 보드는 기본으로 10Gbps 포트 2개, 2.5Gbps 포트 1개가 박혀 있습니다. (저는 대기 전력조차 아끼기 위해 2.5Gbps 환경으로 타협해 씁니다.) SATA 포트 역시 메인보드 SFF-8643 + HBA 카드 조합으로 총 24개를 뚫어두었습니다. 평생 업그레이드할 일 없는 끝판왕입니다.

3. NVMe 200% 활용법: 시놀로지가 막아둔 NVMe의 자유

시놀로지 유저분들이 가장 답답해하시는 것 중 하나가 "왜 내 비싼 NVMe를 캐시로만 가둬두느냐" 일 겁니다. (비공식 스크립트를 쓰거나 비싼 시놀로지 정품을 써야만 볼륨으로 잡히죠.) 저는 보드에 달린 2개의 NVMe를 14개의 HDD를 완벽하게 재우는(Idle) 핵심 키로 마음껏 씁니다.

OS 및 서비스 구동 (NVMe 1): 600GB를 떼어내어 OMV OS, 도커, Plex, Win11 KVM 등을 올려두었습니다.

무중단 OS 백업 (NVMe 2): 400GB를 할당해 매일 아침 스케줄러가 자동으로 NVMe 1의 OS 영역을 rsync로 그대로 복사하여 백업합니다. 1번이 뻗어도 즉시 2번으로 부팅해 1초 만에 복구합니다.

Velocity Pool (1TB 캐시): 두 NVMe의 남는 용량을 합쳐 1TB짜리 SSD 전용 풀을 만들었습니다. 잦은 입출력(I/O)이나 토렌트 다운로드는 전부 이 풀에서 처리하고, 정리가 끝난 데이터만 HDD NAS 풀로 넘깁니다.

4. 정착한 해답: OMV + MergerFS + SnapRAID

시놀로지의 SHR(Synology Hybrid RAID)도 훌륭하지만, 하드가 14개쯤 되면 치명적인 단점이 생깁니다. 바로 영화 한 편만 보려고 해도 14개의 하드가 전부 웽~ 하고 스핀업(Spin-up) 된다는 것입니다. 그 어마어마한 진동, 소음, 전기세, 그리고 하드 수명 갉아먹는 소리가 참기 힘들었습니다. 그래서 선택한 것이 MergerFS와 SnapRAID의 조합입니다.

📌 MergerFS의 미친 유연성과 극강의 전력 절감

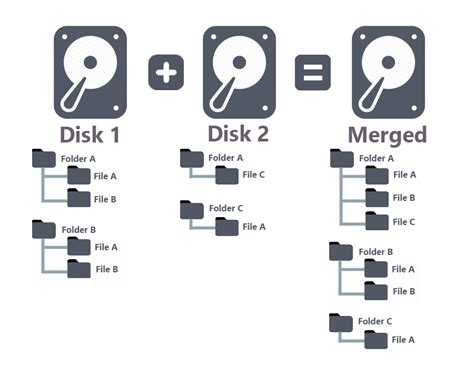

어떤 조건이든 묶어내는 호환성: 용량, 제조사, 심지어 파일시스템(XFS, ext4, FAT, NTFS 등)이 제각각 섞여 있어도 MergerFS는 하나의 거대한 폴더로 묶어줍니다.

독립성 유지: SHR이나 RAID 5처럼 데이터를 쪼개지 않고 '파일 1개' 단위로 저장합니다. 디스크 하나가 불량 나도 전체 풀이 깨지는 게 아니라 해당 디스크만 아웃됩니다.

압도적인 전력 절감 (시놀로지와의 가장 큰 차이): 저는 FF (First Found) 정책을 써서 1번 하드부터 순서대로 꽉 채운 뒤 다음 하드로 넘어갑니다. 영화 한 편을 볼 때 해당 파일이 든 하드 1개만 돌고 나머지 13개는 꿀잠(Idle)을 잡니다. 14베이를 굴리면서 8개의 팬을 풀가동해도 아이들 30W가 나오는 비결입니다.

각각의 디스크에서 각각의 자료를 독립적으로 보관하며, 경로와 폴더이름만 같다면 MergerFS에서는 하나의 폴더에 이를 표시해준다는 설명

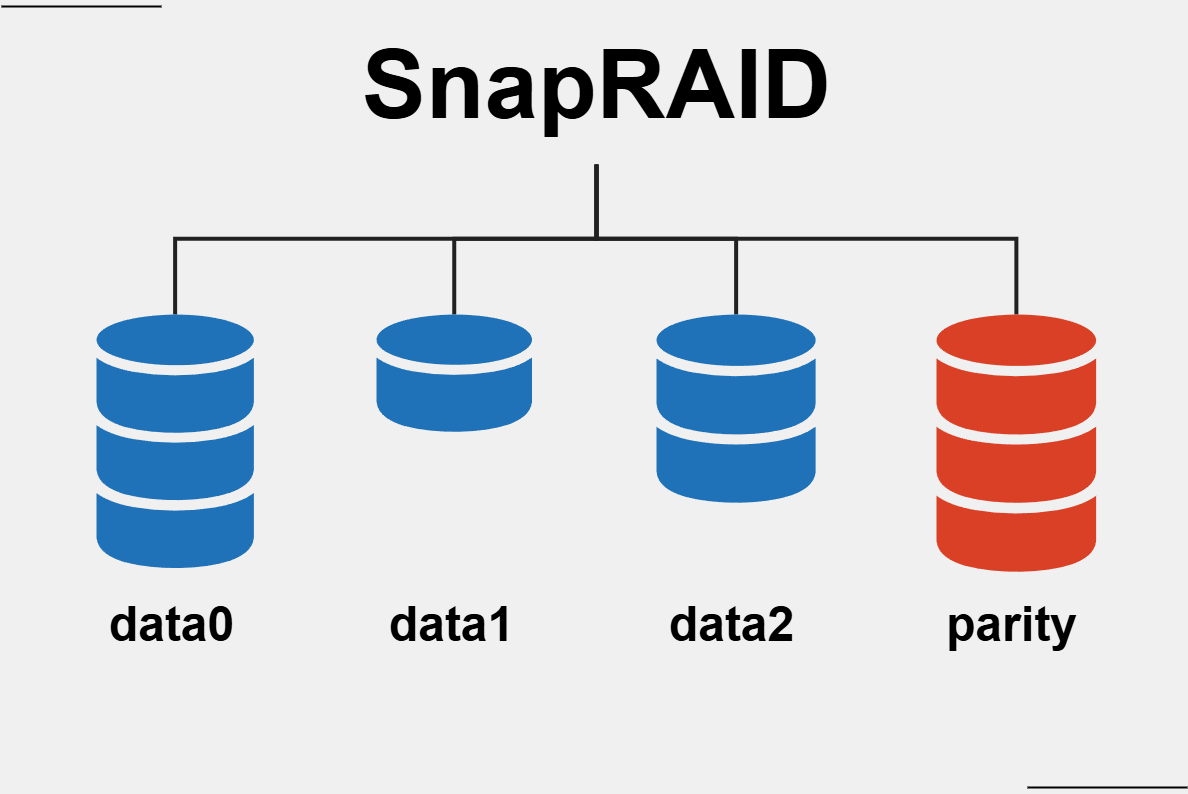

📌 SnapRAID의 무결성 (ZFS나 Btrfs를 버려도 되는 이유)

현재 총 14개의 하드 중 2개를 패리티(복구용) 전용으로 할당하여 2-Parity 구성(하드 2개 동시 사망 방어)을 맞췄습니다.

데이터 부패 (Bit Rot) 완벽 방지: 시놀로지가 Btrfs를 고집하는 이유가 바로 이 Bit Rot 방지 때문이죠. 하지만 SnapRAID를 쓰면 가볍고 안정적인 XFS 파일시스템 위에서도 완벽한 방어가 가능합니다. 파일 지문을 대조해 깨진 데이터를 찾아내고 원상 복구해냅니다. 무거운 ZFS나 Btrfs 없이도 완벽한 데이터 무결성 방어막을 두르는 셈이죠.

스케줄링 동기화 및 자동 스크럽(Scrub): 하드에 무리를 주지 않기 위해 일주일에 한 번 systemd 타이머로 동기화(Sync)가 돌고, 끝나면 곧바로 전체 데이터의 3% Scrub(오류 검사)이 이어지도록 자동화했습니다. 매달 또는 정해진 날에 Scrub을 한번에 100%를 모두 돌리는건 152TB라는 용량때문에 몇일간 NAS사용을 못하는것이 부담스러워서 이렇게 하였습니다. 매주 3%면 약 8개월마다 전체 디스크의 데이터 부패 여부를 한 바퀴 완벽하게 전수 검사하게 됩니다.

[사진설명]

디스코드로 매일 아침에 받는 점검 메시지

월~목, 토, 일 : 시스템 rsync 미러링 백업 + S.M.A.R.T 마운트 테스트 (1~3분내 완료)

금요일: 시스템 rsync 미러링 백업 + S.M.A.R.T short 테스트 + Snapraid Sync + Snapraid Scrub 3% (1시간 반 정도 소요)

실수 복구(타임머신): 실시간 동기화가 아니기 때문에, 실수로 파일을 지워도 다음 동기화 전까지는 패리티에 이전 정보가 남아 있어 삭제한 파일도 살려낼 수 있습니다.

저의 설정에서 만약 동시에 어떤 조합으로든 동시에 디스크 3개가 날아간다면 패리티 디스크로 복구는 불가능하지만, 날아간 데이터 디스크 외 나머지 디스크들은 멀쩡히 그대로 독립적으로 데이터가 살아 있습니다. 이런 기능은 트루나스 ZFS든 시놀로지의 Btrfs든, 레이드 6든 어떤 시스템으로도 불가능합니다. 이게 바로 Snapraid와 MergerFS의 독립적인 파일 시스템 유지의 장점 입니다.

5. 완벽해 보이지만, 분명한 단점들도 있습니다

이 시스템이 높은 점수를 받지만, 시놀로지와 ZFS 대비 명확한 한계점도 솔직하게 짚어보겠습니다.

[기성품 대비 단점: 내가 곧 고객센터]

시놀로지는 문제가 생기면 폰 알림이 오고 버튼 몇 번 누르면 해결되죠. '시놀로지 포토'나 '드라이브' 같은 킬러 앱의 부재도 큽니다. 이 시스템은 오류가 생기면 터미널 창을 열고 리눅스 명령어(sed, cat 등)를 치며 원인을 직접 찾아야 합니다. 시놀로지 포토, 드라이브와 유사한 앱은 있지만 DSM에서 하듯이 클릭 몇번으로 설치하는게 아니라 도커로 직접 올려야 하죠. 이런 설정도 리눅스로 구성을 해야하는 번거로움이 있습니다. 기능적으로 OMV로 구사 불가능한 시놀로지, 큐냅의 기술은 없습니다. 하지만 '돈으로 시간을 사는' 기성품의 편안함은 절대 무시할 수 없습니다.

[ZFS 대비 단점: 퍼포먼스와 '마의 시간대']

속도의 한계: ZFS나 하드웨어 RAID는 여러 하드를 동시에 읽어 대역폭을 찢어버리지만, MergerFS는 최대 전송 속도가 하드 1개의 물리적 속도(약 250MB/s)를 넘을 수 없습니다. 영상 편집용 실시간 서버로는 부적합합니다.

실시간 보호 불가: 현재 저의 SnapRAID는 일주일 주기의 동기화 스케줄링입니다. 동기화가 끝난 다음 날 중요한 데이터를 넣고 그날 하드가 죽어버리면 새 데이터는 날아갑니다. 매일 또는 매시간 동기화 스케줄링을 할수도 있겠지만 전력도 아끼고 여유를 가지는 세팅을 위해서 저는 일주일 동기화로 설정하였습니다. 그래서 잦은 입출력 데이터는 NVMe Velocity 풀에서 1차 처리 및 보관하고, 나중에 정돈된 데이터만 HDD 풀로 넘기는 것입니다.

[자작 NAS의 추가적인 업그레이드]

참고로 기성품중에도 최근에 핫한 UGREEN의 나스가 기본 모델이 N100을 달고 있고, 중급모델이 인텔 펜티엄 골드 8505를 달고 나오는데 이런 CPU에 10Gbps 랜 포트, 썬더볼트 4 포트까지 빵빵하게 넣어놔서 하드웨어만 보면 생태계 교란종 수준입니다. 더구나 락인이 되어있지 않는 탓에 순정 OS를 시원하게 밀어버리고, 그 위에 OMV, TrueNAS, Unraid 및 자기가 원하는 OS를 설치해서 씁니다. 하드웨어 깡스펙만 보고 사는 최고의 베어본 장난감으로 취급받고 있습니다. 정말 추천하지 않을 수 없는 구성입니다.

6. 어려워 보이지만 누구든 가능한 NAS구축

이전에는 편의성과 깔끔한 기존 상용 NAS를 고집했지만 갈수록 커져가는 데이터용량과 고지식하기 짝이 없는 NAS 제조사들의 횡포로 인해 이제 24베이 NAS는 HDD를 포함하면 천만원을 생각해야 하는 시대가 오고 있습니다. 금액 문제만이 아닙니다. NAS 제조사들은 락인전략을 유지하기위해 지속적으로 발전중인 안정적이고 유연성있는 소프트웨어 기술을 도입하는데 매우 보수적입니다. 각기 다른 파일시스템, 다른 사이즈의 HDD들을 1개의 디스크풀로 안정적으로 유지하는 이런 기술들은 앞으로도 도입되기 어려울것입니다.

[사진설명]

NAS의 네트워크 드라이브로 다운로드 중이지만, nvme인 velocity_pool 에 쓰기 때문에 나머지 디스크들은 모두 idle상태

Ram 32gb에서 8gb는 Win 11을 kvm으로 돌리기 위해 할당한 상태

Proxmox가 요즘 핫하더라구요. 다만 152TB급 아카이빙 서버에 하이퍼바이저를 얹고 패스스루로 돌리는 구조는, 제 기준에선 좀 돌아가는 설계입니다. 아카이빙 서버에는 베어메탈이 가장 단순하고 예측 가능하고 오버헤드 최소이다보니 가성비충인 저는 VM 안정성보다 디스크 14개를 직접 제어하는 직관성을 택했습니다. 필요한 하드만 깨워서 30W 유지하는 구조가, 사용 목적엔 더 맞더군요. 이미 KVM 기반으로 Win11도 돌리고 있고, n8n이나 각종 서비스도 도커로 충분히 올리고 있는 상황이라 제 환경에선 굳이 하이퍼바이저를 하나 더 얹어야 할 필요성은 느끼지 못했습니다.

혹시 제 글을 보고 OMV를 설치해보셨다가, 대시보드를 열자마자 살짝 허탈하셨던 분들도 계실 것 같습니다. 솔직히 말하면 그 반응이 정상입니다. OMV는 화려하지도 않고, 앱스토어처럼 뭔가가 쏟아져 나오지도 않습니다. 버튼 몇 번으로 모든 게 해결되는 구조도 아닙니다. 처음 보면 “이게 끝인가?” 싶은 수준의 관리 화면이 전부입니다. 그런데 제가 선택한 이유도 바로 거기에 있습니다.

제가 극찬한 건 OMV라는 특정 OS가 아니라, 그 위에서 돌아가는 MergerFS + SnapRAID라는 스토리지 설계 조합입니다. OMV는 그 조합이 리눅스 커널 위에서 최대한 간섭 없이 돌아가도록 판만 깔아주는 역할입니다. 비어 있는 게 아니라, 개입이 적은 겁니다. 뭔가를 강요하지 않고, 특정 파일시스템이나 RAID 방식을 전제로 하지 않고, 그냥 최소한의 관리 레이어만 얹어 둔 상태입니다.

많은 분들이 GUI에서 모든 게 해결되길 기대합니다. 저도 마찬가지입니다. 하지만 현실적으로 조금만 깊이 들어가면 시놀로지든 큐냅이든 결국 CLI를 거치게 됩니다. 트루나스도 ZFS를 조금만 튜닝하려 하면 쉘을 열게 되고, Proxmox도 진짜 운용 단계로 가면 터미널을 피할 수 없습니다. 어차피 쉘을 열어야 할 상황이라면, 중간에 무거운 껍데기를 둘 이유가 없다고 판단했습니다. 그래서 저는 베어메탈에 가까운 가벼운 바닥을 선택했습니다.

그리고 이건 제 개인적인 경험인데, OMV이든, TrueNAS이든, 큐냅이든 GUI와 CLI를 어설프게 섞어 쓰다가 오히려 설정이 꼬이는 경우를 여러 번 겪었습니다. GUI에서 한 번 설정하고, 마음에 안 들어서 CLI에서 직접 수정하고, 나중에 OMV가 다시 그 설정을 덮어쓰는 식으로 충돌이 나더군요. 그 과정에서 시스템을 믿지 못하는 상태가 생기는 게 더 스트레스였습니다. 그래서 지금은 역할을 명확히 나눴습니다. OMV는 딱 대시보드 수준의 기본 관리용으로만 쓰고, 스토리지 구조나 세부 설정은 AI 도움을 받아 CLI에서 직접 제어합니다. 중간에서 서로 간섭하지 않게 경계를 정해둔 셈입니다. 다만, 시놀로지의 DSM은 예외라고 생각합니다. 근본적인 자유도의 제약은 있긴하지만 GUI로 거의 모든걸 해결할 수 있는 유일한 OS인것 같습니다. 그 제약이 너무 강해서 문제이긴 하지만요 (예: nvme를 디스크 캐시로만 사용 가능, OS설치는 불가능)

OMV는 완성품이 아닙니다. 인테리어가 아니라 기초 콘크리트에 가깝습니다. 심지어 OMV가 아니어도 상관없습니다. 우분투 순정이든 데비안이든 리눅스 환경이면 이 조합은 어디서든 구현 가능합니다. 다만 저는 최소한의 GUI로 기본 상태만 확인하고, 나머지는 직접 통제할 수 있는 환경이 필요했을 뿐입니다. 24시간 돌아가는 서버에서 제 기준에 중요한 건 화려함이 아니라 간섭이 적은 구조였습니다.

그래서 OMV를 무시하는 시선을 보면 조금 아쉽습니다. 겉으로 보이는 대시보드는 심심할 수 있습니다. 하지만 그 위에 무엇을 얹느냐에 따라 전혀 다른 시스템이 됩니다. OMV는 그 설계를 담는 가장 얇은 그릇이었을 뿐입니다.

여러 번 말했듯이 이 시스템이 NAS의 종결자는 아닙니다. 다만 아카이빙 비중이 높고 디스크를 계속 확장할 사람이라면, 꽤 많은 경우 ZFS보다 더 행복할 수 있다고 생각합니다. 설계를 고민하기보다 파일시스템을 진리처럼 선택하는 문화는 개인적으로 경계하고 있습니다. 반대로 실시간 무결성과 즉시 보호가 필요한 워크로드라면 ZFS나 하드웨어 RAID(1/10) 같은 실시간 동기화 시스템을 더 권하고 싶습니다.

요즘 컴퓨터는 어떤게 변했는지 잘 몰랐는데

시스템 보면서 배워가는게 정말 많네요 특히 파워 유니버셜 단자가 매우 매력적입니다

N100 메인보드도 너무 좋아보이구요

그리고 MergerFS 요게 정말 마음에 드네요 정보감사합니다 정말 유용할거 같습니다

예전에 RAID6 구성해놓고 하나 불량나서 새걸로 교체한다는게 옆에 정상인걸 빼서 사서 고생했던 기억이 났습니다..

즐겁게 감상하고 갑니다

MergerFS는 특히 확장성과 독립성 면에서 매력이 크죠. RAID6 실수 경험 있으시면 더 공감되실 것 같습니다 ㅎㅎ 읽어주셔서 감사합니다!

메인 서버와 백업 서버의 역할 분리도 명확합니다. Proxmox 메인 서버는 NVMe 1–2개만 장착해 HDD 없이 VM과 PBS를 운용하고, 백업 서버는 네이티브 OMV 환경에서 여러 개의 HDD를 구성해 PBS 스토리지를 NFS로 마운트합니다. OMV의 가벼운 시스템 성능과 네이티브 SSH 접근 덕분에 세팅 및 유지 관리가 더욱 간편해질 것 같습니다.

XFS + MergerFS + SnapRAID 관련 소중한 정보 정말 감사합니다.

저도 비슷한 용량에 20년 넘게 windows os 로 관리하다가 작년에 unraid로 갈아타고 1. 사용하지 않는 하드 절전, 2. 한과장님 스토리지와 비슷한 unraid 스토리지 시스템, 3. vm, docker, appstore? 편리 이 점 때문에 만족하며 쓰고 있습니다.

unraid 는 처음부터 후보군에 없었는지 궁금합니다.